llama.cpp

介绍

llama.cpp 是一个用 C/C++ 编写的高效开源项目,其核心目标是在消费级硬件(特别是 CPU)上本地运行大型语言模型。它最初由 Georgi Gerganov 开发,专注于对 Meta 的 LLaMA 系列模型进行高效的推理,现已扩展支持众多其他开源模型。

核心特点:

- 纯 CPU 推理: 核心优势在于无需强大的独立显卡(GPU),仅依靠 CPU 和内存即可运行数十亿参数的大模型。这极大降低了本地部署 AI 的门槛。

- 极致性能与量化: 项目采用高度优化的计算内核(如 AVX2、AVX-512)并积极推动模型量化技术。通过将模型权重从 FP16 压缩到 4-bit 甚至更低精度,在极小精度损失下大幅减少内存占用、提升推理速度。

- 轻量级与跨平台: 项目本身依赖极少,编译后得到一个轻量的可执行文件。支持 Windows、Linux、macOS 等多种操作系统,甚至可以在树莓派、手机等嵌入式设备上运行。

- 丰富的生态与接口: 除了基础的命令行交互外,还提供了:

- 类 OpenAI 的 HTTP API 服务器,方便与其他应用集成。

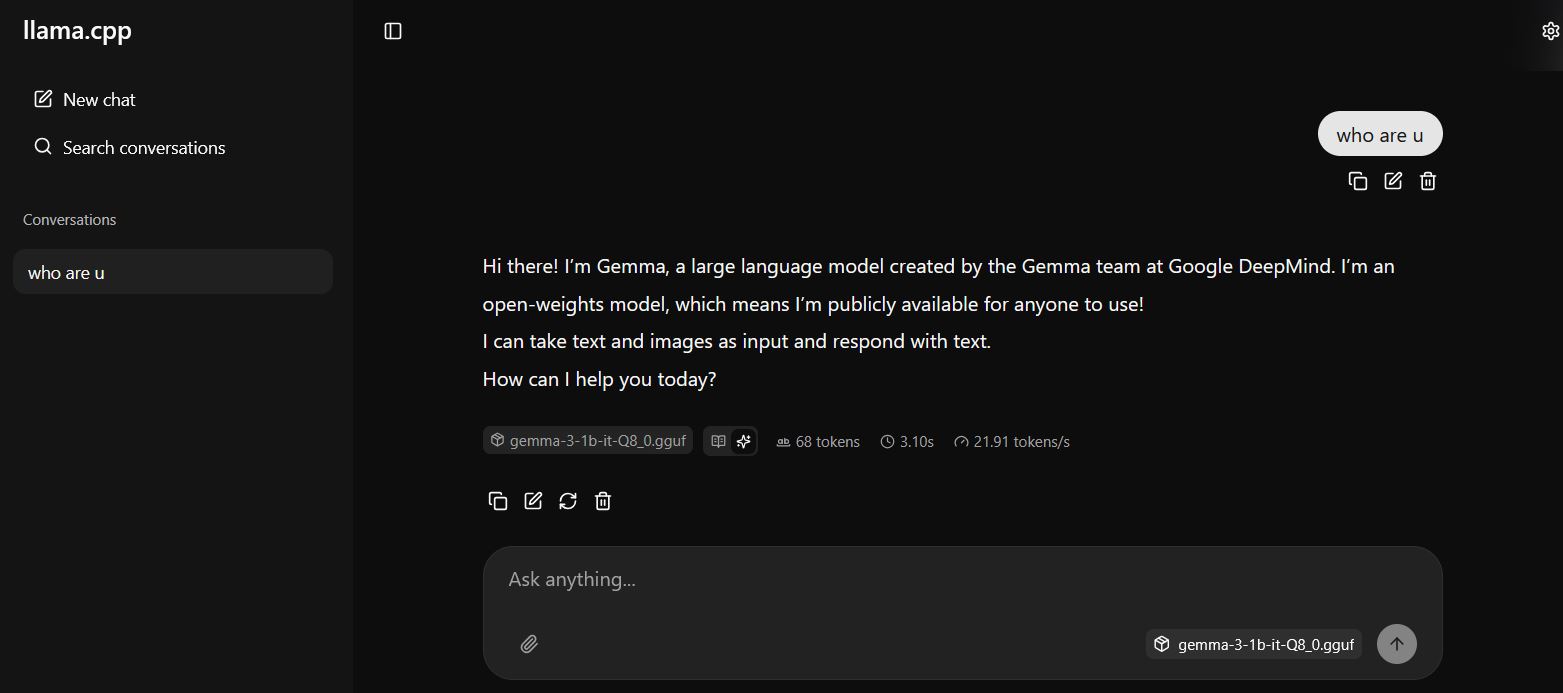

- Web UI 和 GUI 客户端支持,提供用户友好的聊天界面。

- 与 LangChain 等 AI 应用框架的集成。

- 开放的模型格式: 推动并普及了 GGUF 这一自有的模型文件格式。GGUF 格式针对 llama.cpp 的推理引擎进行了优化,集成了模型的架构、权重、分词器、量化信息等,便于分发和加载。

典型应用场景:

- 在无GPU的个人电脑(如笔记本、台式机)上本地运行聊天助手。

- 在隐私敏感的环境中离线处理文档、进行代码补全或创作。

- 为开发者提供一个轻量、高效的后端,用于集成 AI 功能到其他应用程序中。

- 研究和体验最新开源大模型,而无需昂贵的云计算资源。

重要性: llama.cpp 是大模型民主化进程中的关键里程碑。它打破了运行大模型对专业硬件的依赖,让任何拥有普通电脑的人都能在本地体验和控制大模型,极大地推动了开源 AI 在终端侧的普及和应用创新。

Generated by AI

图片

获取

Available on github:https://github.com/ggml-org/llama.cpp

Direct Download:

llama.cpp:65d19c72-5d3b-4c4f-a44a-ad717c4d20d4

一些模型:0a27079f-a53c-46f5-b149-75cfb09303a8

备注

你需要安装最新版本的vc++运行库才能够运行llama.cpp,可以在这里下载:https://learn.microsoft.com/en-us/cpp/windows/latest-supported-vc-redist?view=msvc-170#latest-supported-redistributable-version